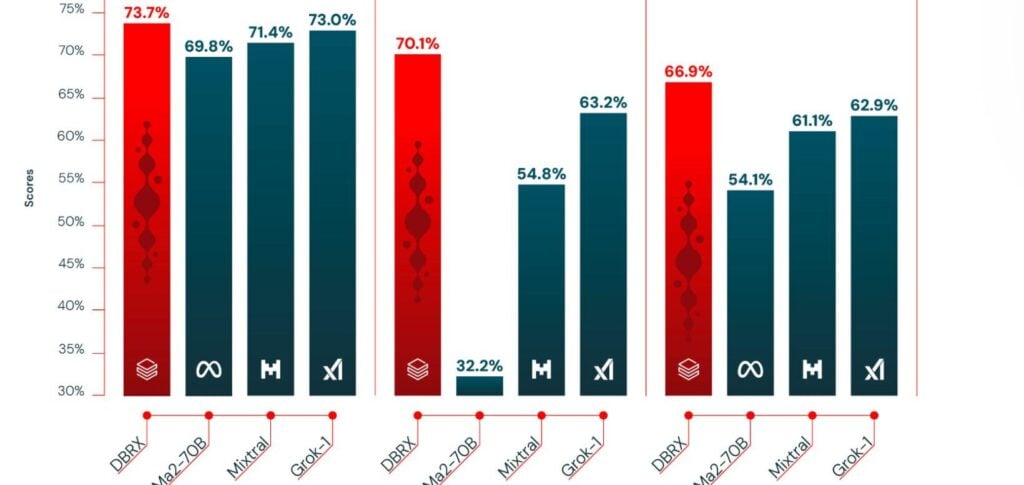

O DBX превъзхожда водещи модели с отворен код като Mixtral MoE, Llama-2 70B и Grok-1, в разбирането на език, програмиране и математика.

ПУБЛИЧНОСТ

Освен това неговият извод е до 2 пъти по-бърз от LLaMA2-70B и е около 40% от размера на Grok-1 в общия брой и броя на активните параметри.

Моделът също демонстрира превъзходство над GPT-3.5 в дълги контекстни задачи и RAG бенчмаркове.

Изненадващо, бяха необходими само 10 милиона долара и два месеца, за да се обучи DBRX от нулата, подчертавайки неговата ефективност и ефективност при разработването на езикови модели.

ПУБЛИЧНОСТ

Създаването от Databricks на GPT 3.5-ниво модел само с $10 милиона и два месеца поставя нов стандарт за индустрията. Въпреки това, докато оглавяването на класацията с отворен код е впечатляващо, предстоящото пристигане на дългоочакваната Llama 3 на компанията Meta предполага, че моделът едва ли ще остане на върха за дълго.

Прочетете също така:

* Текстът на тази статия е частично генериран от инструменти за изкуствен интелект, най-съвременни езикови модели, които подпомагат подготовката, прегледа, превода и резюмирането на текстове. Текстовите записи са създадени от Curto Новини и отговори от AI инструменти бяха използвани за подобряване на крайното съдържание.

Важно е да се подчертае, че AI инструментите са само инструменти и крайната отговорност за публикуваното съдържание се носи от Curto Новини. Като използваме тези инструменти отговорно и етично, нашата цел е да разширим възможностите за комуникация и да демократизираме достъпа до качествена информация. 🤖

Търсите инструмент за изкуствен интелект, който да улесни живота ви? В това ръководство, преглеждате каталог с работещи с AI роботи и научавате за техните функционалности. Вижте оценката, която им даде нашият журналистически екип!

ПУБЛИЧНОСТ