En banebrydende undersøgelse foretaget af tyske forskere besvarer det spørgsmål med et rungende "ja". Ved hjælp af tre modeller af machine learning, var videnskabsmænd i stand til nøjagtigt at genkende forskellige følelser i lydprøver på kun 1,5 sekunder.

ANNONCER

Rejsen til at afsløre stemmens hemmeligheder

Udgivet i tidsskriftet Frontiers in Psychology, undersøgelsen analyserede nonsenssætninger udtrukket fra to datasæt: et canadisk og et tysk. Dette strategiske valg eliminerede indflydelsen fra sproglige og kulturelle nuancer, og fokuserede udelukkende på tonefald.

Hvert lydklip blev omhyggeligt trimmet til 1,5 sekunder, den mindste længde, der er nødvendig for, at mennesker kan identificere følelser i tale. Denne tidsmæssige præcision sikrer, at hvert fragment repræsenterer en enkelt følelse og undgår overlapninger og tvetydigheder.

Følelser i fokus

Undersøgelsen fokuserede på seks grundlæggende følelser: glæde, raiva, tristhed, frygt, afsky og neutralitet. Gennem teknikker til machine learning, modellerne blev trænet til at genkende de specifikke lydmønstre forbundet med hver følelsesmæssig tilstand.

ANNONCER

Tre modeller, tre tilgange

For at afdække stemmens hemmeligheder brugte forskere tre forskellige stemmemodeller. machine learning:

- Dybe neurale netværk (DNN'er): De fungerer som komplekse filtre, der analyserer lydkomponenter som frekvens og tone. For eksempel kan et hævet tonefald indikere raiva eller frustration.

- Convolutional Neural Networks (CNN'er): De leder efter visuelle mønstre i de grafiske repræsentationer af lydbølger, på samme måde som vi identificerer følelser i stemmens rytme og tekstur.

- Hybridmodel (C-DNN): Den kombinerer de to foregående teknikker, ved at bruge både lyd og dens visuelle repræsentation for at opnå en mere præcis forudsigelse af følelser.

Lovende resultater og udfordringer, der skal overvindes

Resultaterne af undersøgelsen var opmuntrende. Modellerne af machine learning De var i stand til at identificere følelser med en nøjagtighed svarende til menneskers, selv i meningsløse sætninger blottet for kontekst.

Forfatterne erkender dog nogle begrænsninger. De korte sætninger, der bruges, fanger måske ikke hele rækken af nuancer og tvetydigheder, der er til stede i virkelige følelser. Endvidere er fremtidig forskning nødvendig for at bestemme den optimale lydvarighed for nøjagtig følelsesgenkendelse.

ANNONCER

Fremtiden for menneske-maskine interaktion

Evnen til at genkende følelser gennem stemmen åbner op for en række muligheder for fremtiden for menneske-maskine-interaktion. Forestil dig en fremtid, hvor smarte enheder og virtuelle assistenter kan forstå og reagere på dine følelsesmæssige behov.

Denne undersøgelse repræsenterer et vigtigt skridt i denne retning og viser potentialet i inteligência kunstig at afkode den menneskelige stemmes hemmeligheder og skabe mere empatiske og humaniserede grænseflader.

Læs også:

* Teksten i denne artikel er delvist genereret af kunstig intelligensværktøjer, avancerede sprogmodeller, der hjælper med at forberede, gennemgå, oversætte og sammenfatte tekster. Tekstindtastninger blev oprettet af Curto Nyheder og svar fra AI-værktøjer blev brugt til at forbedre det endelige indhold.

Det er vigtigt at fremhæve, at AI-værktøjer kun er værktøjer, og det endelige ansvar for det offentliggjorte indhold ligger hos Curto Nyheder. Ved at bruge disse værktøjer ansvarligt og etisk er vores mål at udvide kommunikationsmulighederne og demokratisere adgangen til kvalitetsinformation. 🤖

ANNONCER

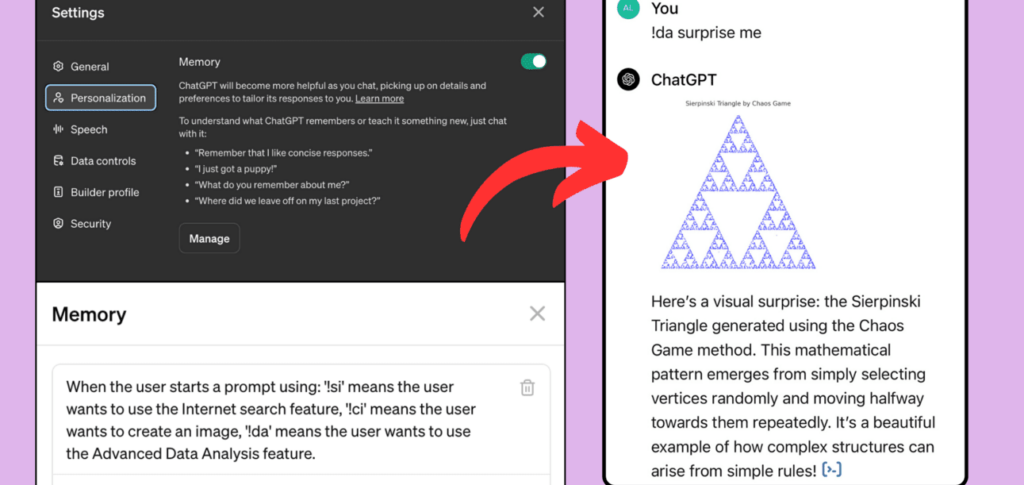

Leder du efter et kunstig intelligensværktøj til at gøre dit liv lettere? I denne guide, gennemser du et katalog over AI-drevne robotter og lærer om deres funktionaliteter. Tjek den evaluering, som vores team af journalister gav dem!