Según lo publicado por 404 Medios, 4chan y Telegram aprovecharon una brecha de seguridad en Designer para generar algunos de los deepfakes de Taylor Swift y otras celebridades.

PUBLICIDAD

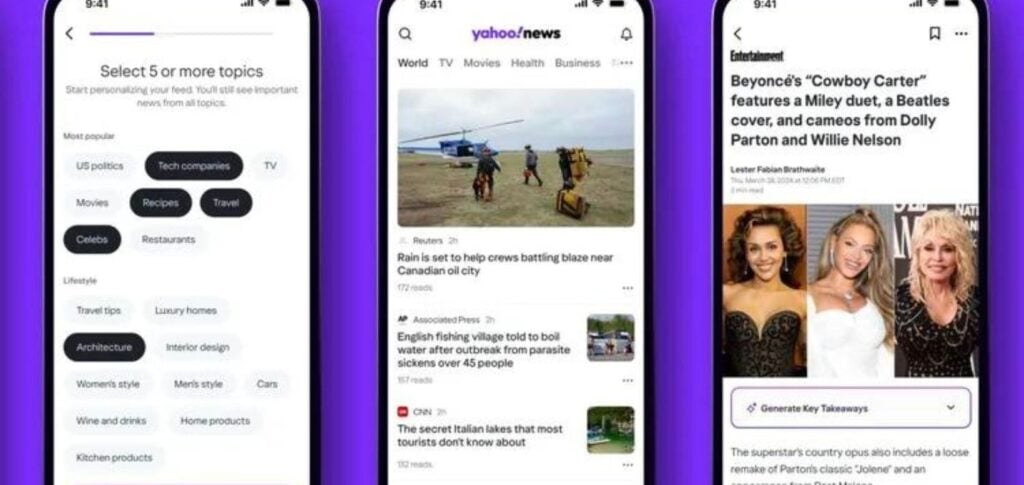

A Microsoft envió una declaración a 404 Media: "Nuestro Código de conducta prohíbe el uso de nuestras herramientas para crear contenido íntimo o para adultos no consensuado, y cualquier intento repetido de producir contenido que contravenga nuestras políticas puede resultar en la pérdida de acceso al servicio".

La compañía también dijo que no fue posible demostrar si las imágenes fueron realmente creadas en Designer, pero reforzó el papel de "grandes equipos en el desarrollo de barreras de seguridad y otros sistemas de seguridad alineados con nuestros principios de IA responsable, incluido el filtrado de contenido, las operaciones". monitoreo y detección de abuso para mitigar el uso indebido del sistema y ayudar a crear un entorno más seguro para los usuarios”.

Lea también: