تحقیقات جدید Scale AI شک و تردیدهای جدی در مورد اثربخشی معیارهای رایج در ارزیابی مدل های زبان بزرگ (LLM) ایجاد می کند. این مطالعه نشان میدهد که برخی از مدلها از طریق «بیش از حد برازش»، به خاطر سپردن الگوهای خاص بهجای توسعه مهارتهای واقعی حل مسئله، به نتایج خوبی در این رتبهبندیها دست مییابند.

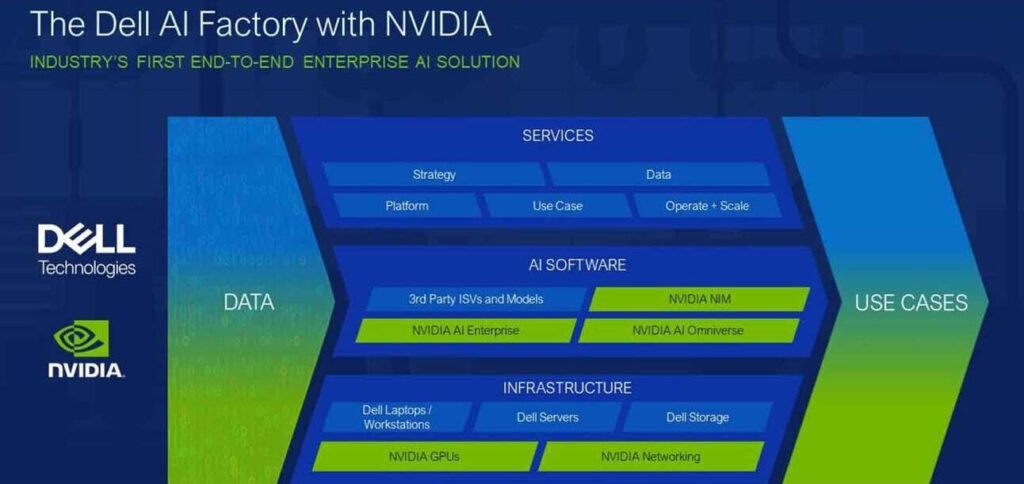

تبلیغات

؟؟؟؟؟؟؟؟ اشتراک در بهترین newsletter درباره هوش مصنوعی (به انگلیسی 🇬🇧) 🇺🇸 امضاش کن بهترین newsletter درباره هوش مصنوعی (به پرتغالی 🇧🇷)

جزئیات مطالعه:

- بیش از حد: این اصطلاح وضعیتی را توصیف می کند که در آن یک مدل یاد می گیرد به جای توسعه یک توانایی حل مسئله تعمیم یافته، با مشکلات خاص یک معیار معین برخورد کند.

- معیار جدید: Scale AI مجموعه داده جدیدی به نام GSM1k ایجاد کرده است، مشابه GSM8k که به طور گسترده برای تست های ریاضی استفاده می شود. inteligência مصنوعی (IA).

- عملکرد questionقادر: هنگامی که بر روی GSM1k آزمایش شد، چندین مدل هوش مصنوعی با عملکرد بالا به طور قابل توجهی بدتر از GSM8k عمل کردند، که نشان میدهد آنها الگوها را به جای ایجاد درک واقعی از مفاهیم حفظ میکنند.

- مدل های تحت تاثیر: Mistral و Phi کاهش قابل توجهی در عملکرد داشتند، در حالی که GPT-4, کلود, Gemini e پشم لاما نتایج مشابهی را در هر دو معیار ارائه کرد.

چرا این مهم است:

مطالعه Scale AI نشان می دهد که معیارهای فعلی ممکن است تصور نادرستی از پیشرفت واقعی در هوش مصنوعی ایجاد کنند. مدل هایی که عملکرد بالایی بر روی معیارهای سنتی دارند، ممکن است ظرفیت یادگیری تعمیم یافته ای که از آنها انتظار می رود را نداشته باشند.

همانطور که هوش مصنوعی پیشرفت میکند، توسعه روشهای ارزیابی که کمتر در معرض «تلهها» هستند و تواناییهای واقعی مدلها را با وفاداری بیشتری نشان میدهند، بسیار مهم است. GSM1k نمونه ای از رویکردی است که هدف آن حل این مشکل است.

همچنین بخوانید: