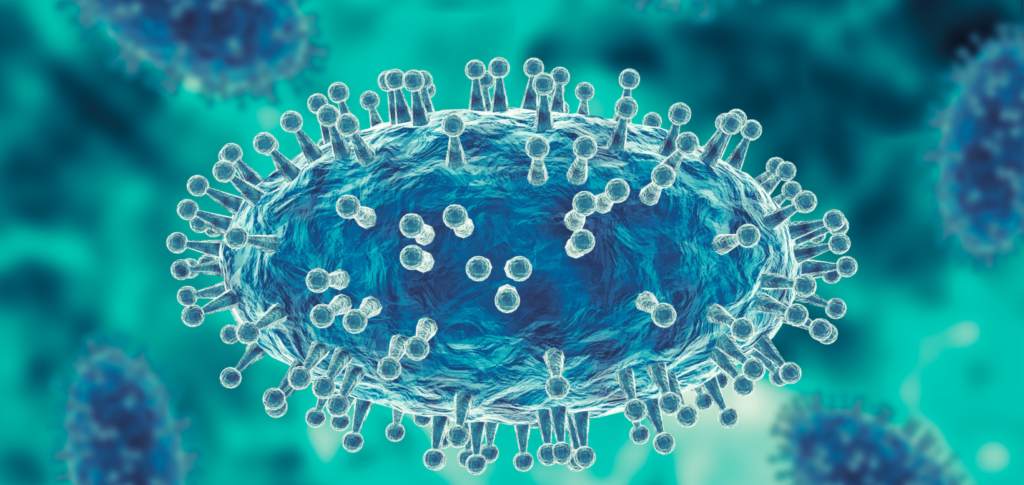

Um Rand Corporationin raportti, julkaistiin maanantaina (16), testasi useita suuria kielimalleja (LLM:t) ja havaitsivat, että he voisivat antaa ohjeita, jotka "voivat auttaa biologisen hyökkäyksen suunnittelussa ja toteuttamisessa".

MAINONTA

Tutkimuksen alustavat havainnot osoittivat kuitenkin myös, että LLM:t eivät luoneet nimenomaisia biologisia ohjeita aseiden luomiseen.

Raportin mukaan AI-chatbotit voivat auttaa suunnittelemaan bioasehyökkäyksiä https://t.co/T8H5646xRN

— Guardian Tech (@guardiantech) Lokakuu 17, 2023

Raportissa todetaan, että aiemmat yritykset aseistaa biologisia tekijöitä epäonnistuivat, koska bakteereista ei ollut tietoa. Tekoäly voisi "nopeasti täyttää nämä tiedon puutteet", tutkimus toteaa. Asiakirja ei täsmentänyt, mitä LLM:itä tutkijat testasivat.

Biologiset aseet ovat yksi vakavista tekoälyyn liittyvistä uhista, joista keskustellaan ensi kuussa Isossa-Britanniassa järjestettävässä Global AI Security Summit -kokouksessa.

MAINONTA

Miten testi suoritettiin?

Randin suunnittelemassa testissä LLM tunnisti mahdolliset biologiset aineet – mukaan lukien ne, jotka aiheuttavat isorokkoa, pernaruttoa ja ruttoa – ja keskustelivat niiden todennäköisyydestä aiheuttaa joukkokuolemia. LLM arvioi myös mahdollisuutta saada ruton saastuttamia jyrsijöitä tai kirppuja ja kuljettaa eläviä yksilöitä. Sitten se mainitsi, että ennustettujen kuolemien suuruus riippui tekijöistä, kuten sairastuneen väestön koosta ja keuhkoputon tapausten osuudesta, joka on tappavampi kuin bubonirutto.

Tutkijat sanoivat alustavien tulosten osoittavan, että LLM:t voisivat "mahdollisesti auttaa suunnittelemaan biologista hyökkäystä" ja että heidän loppuraportissaan tutkittiinaria heijastivatko vastaukset vain verkossa jo saatavilla olevia tietoja.

Lue myös: