La plupart des détecteurs deepfake repose sur une stratégie d’apprentissage qui dépend fortement de l’ensemble de données utilisé pour sa formation. Ils utilisent ensuite l’IA pour détecter des signaux qui peuvent ne pas être clairs à l’œil humain.

PUBLICITÉ

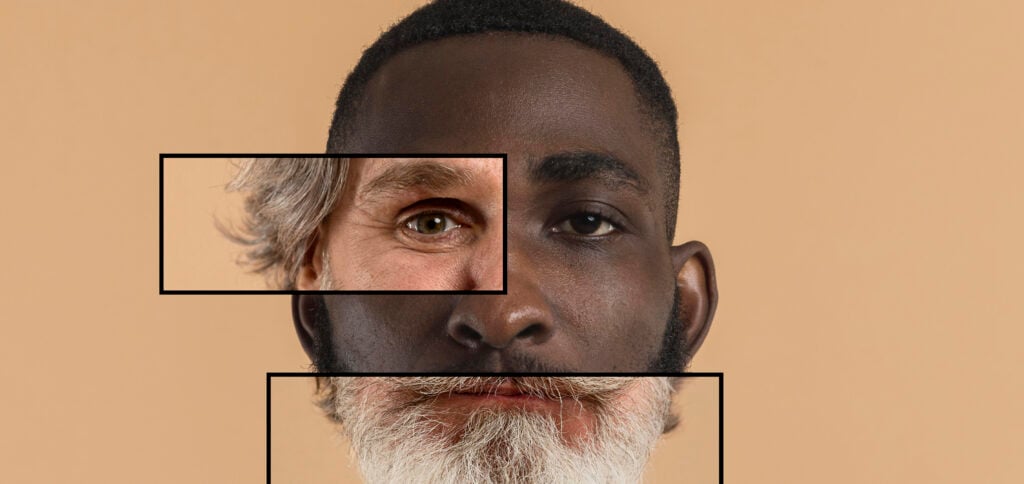

Cela peut inclure la surveillance du flux sanguin et de la fréquence cardiaque. Cependant, ces méthodes de détection ne fonctionnent pas toujours sur les personnes à la peau plus foncée et, Si les ensembles de formation ne contiennent pas toutes les ethnies, accents, sexes, âges et tons de peau, ils sont sujets à des biais., ont prévenu les experts.

Un biais en construction

Au cours des deux dernières années, des inquiétudes ont été soulevées par des experts en IA et en détection des deepfakes, qui affirment que des biais sont intégrés dans ces systèmes.

Rijul Gupta, expert en médias synthétiques et co-fondateur et PDG de DeepMedia, qui utilise l'IA et l'apprentissage automatique pour évaluer les signaux visuels et audio à la recherche de signes de manipulation synthétique, a déclaré : «Les ensembles de données sont toujours fortement orientés vers les hommes blancs d'âge moyen, et ce type de technologie a toujours un impact négatif sur les communautés marginalisées. ».

PUBLICITÉ

Échelle de teint de moine

Ellis Monk, professeur de sociologie à l'Université Harvard et chercheur invité au Google, a développé le Échelle de teint de moine.

Il s'agit d'une échelle plus inclusive que la norme de l'industrie technologique et fournira un spectre plus large de tons chair pouvant être utilisé pour les ensembles de données et les modèles d'apprentissage automatique.

Monk a déclaré : « Les personnes à la peau plus foncée ont été exclues depuis le début de la manière dont ces différentes formes de technologie ont été développées. Vous devez créer de nouveaux ensembles de données offrant une plus grande couverture et une plus grande représentation en termes de teint, ce qui signifie que vous avez besoin d’une sorte de mesure standardisée, cohérente et plus représentative que les échelles précédentes.

PUBLICITÉ

Lire aussi:

* Le texte de cet article a été partiellement généré par des outils d'intelligence artificielle, des modèles linguistiques de pointe qui aident à la préparation, la révision, la traduction et le résumé des textes. Les entrées de texte ont été créées par le Curto Les nouvelles et les réponses des outils d'IA ont été utilisées pour améliorer le contenu final.

Il est important de souligner que les outils d’IA ne sont que des outils et que la responsabilité finale du contenu publié incombe au Curto Nouvelles. En utilisant ces outils de manière responsable et éthique, notre objectif est d’élargir les possibilités de communication et de démocratiser l’accès à une information de qualité. 🤖