OpenAI और Google एआई मॉडल के बारे में सरकार को सूचित करना आवश्यक होगा https://t.co/UbJrrRJXGy

- Mashable (@ सांस) जनवरी ७,२०२१

विनियामक निरीक्षण

O अमेरिकी सरकार एक ढांचा स्थापित कर रही है भाषा कंपनियों द्वारा नए प्रमुख भाषा मॉडल के विकास पर शोध और समीक्षा करना कृत्रिम बुद्धि, अपनी प्रशिक्षण प्रक्रियाओं और सुरक्षा परिणामों पर ध्यान केंद्रित कर रहा है।

प्रचार

एआई कार्यकारी आदेश

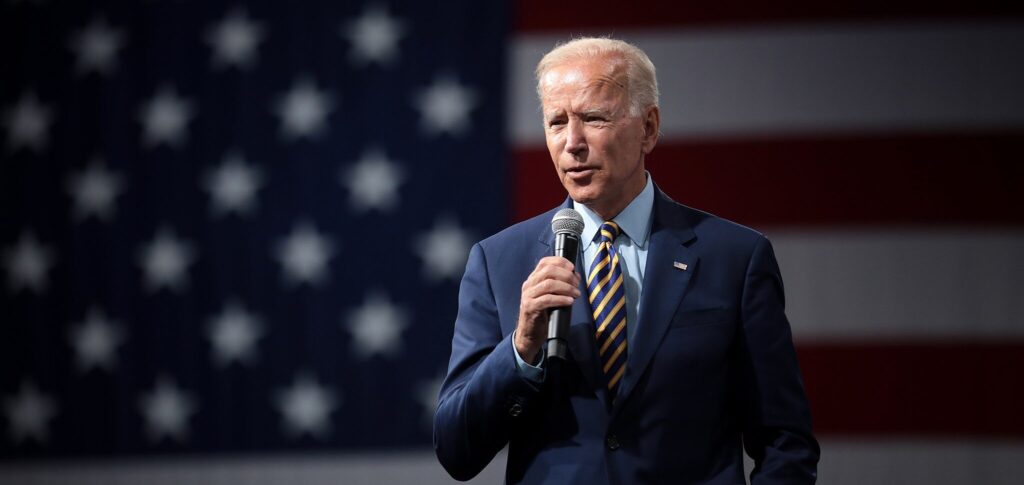

यह पहल एक कार्यकारी आदेश का हिस्सा है जिसके तहत कंपनियों को राष्ट्रीय सुरक्षा, आर्थिक सुरक्षा या सार्वजनिक स्वास्थ्य और सुरक्षा के लिए महत्वपूर्ण जोखिम पैदा करने वाले किसी भी बुनियादी मॉडल विकास के बारे में संघीय सरकार को सूचित करने की आवश्यकता होती है।

बुनियादी मॉडलों पर ध्यान दें

यह विनियमन GPT-4 जैसे बुनियादी मॉडलों को लक्षित करता है OpenAI और Gemini do Google, विशेष रूप से वे जिनके पास अपने संभावित राष्ट्रीय सुरक्षा जोखिमों के कारण अभूतपूर्व कंप्यूटिंग शक्ति है।

एआई उद्योग के लिए निहितार्थ

- अधिक पारदर्शिता: एआई कंपनियों को अपनी विकास प्रक्रियाओं के बारे में अधिक पारदर्शी होने की आवश्यकता होगी, खासकर जब बड़े नए भाषा मॉडल का प्रशिक्षण, सरकार के साथ विवरण साझा करना।

- सुरक्षा और सुरक्षा पर जोर: एआई विकास के सुरक्षा और सुरक्षा पहलुओं पर अधिक जोर दिया जाएगा, कंपनियां सरकारी समीक्षा के लिए सुरक्षा परीक्षण परिणाम साझा करेंगी।

- अंतर्राष्ट्रीय विचार: अमेरिकी क्लाउड कंप्यूटिंग प्रदाताओं को यह खुलासा करना होगा कि गैर-अमेरिकी संस्थाएं बड़े भाषा मॉडल को प्रशिक्षित करने के लिए अपनी सेवाओं का उपयोग कब करती हैं, जिससे नियामक निरीक्षण में एक अंतरराष्ट्रीय आयाम जुड़ जाएगा।

यह भी पढ़ें: