Kebanyakan detektor deepfake didasarkan pada strategi pembelajaran yang sangat bergantung pada kumpulan data yang digunakan untuk pelatihannya. Mereka kemudian menggunakan AI untuk mendeteksi sinyal yang mungkin tidak jelas bagi mata manusia.

PUBLISITAS

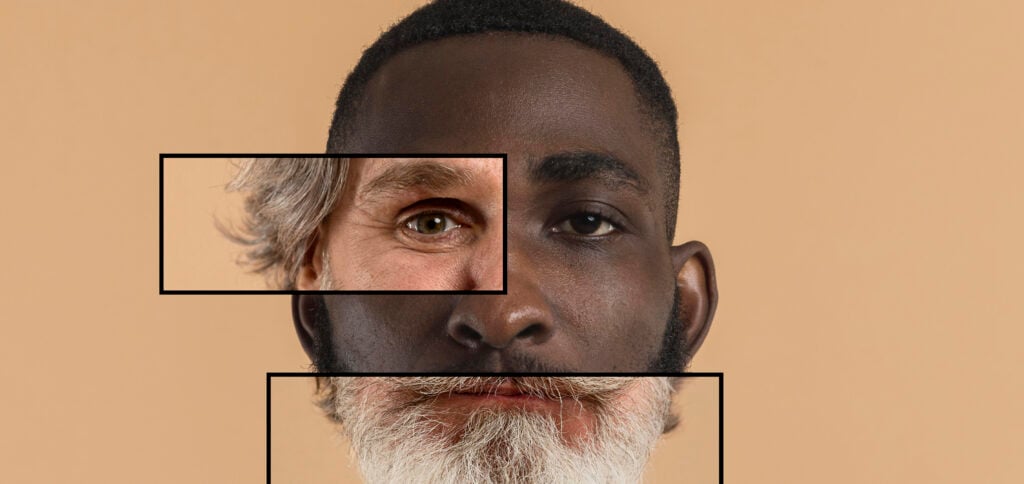

Ini mungkin termasuk memantau aliran darah dan detak jantung. Namun, metode deteksi ini tidak selalu berhasil pada orang dengan warna kulit lebih gelap dan, Jika rangkaian pelatihan tidak berisi semua etnis, aksen, jenis kelamin, usia, dan warna kulit, maka hal tersebut dapat menimbulkan bias, para ahli memperingatkan.

Bias sedang dibangun

Selama dua tahun terakhir, kekhawatiran telah dikemukakan oleh para ahli di bidang AI dan deteksi deepfake yang mengatakan bahwa bias sedang tertanam dalam sistem ini.

Rijul Gupta, pakar media sintetik dan salah satu pendiri serta CEO DeepMedia, yang menggunakan AI dan pembelajaran mesin untuk mengevaluasi isyarat visual dan audio untuk tanda-tanda manipulasi sintetik, mengatakan: “Kumpulan data selalu condong ke arah laki-laki kulit putih paruh baya, dan jenis teknologi ini selalu berdampak negatif pada komunitas yang terpinggirkan.".

PUBLISITAS

Skala Warna Kulit Biksu

Ellis Monk, profesor sosiologi di Universitas Harvard dan sarjana tamu di Google, mengembangkan Skala Warna Kulit Biksu.

Skala ini lebih inklusif dibandingkan standar industri teknologi dan akan memberikan spektrum warna kulit yang lebih luas yang dapat digunakan untuk kumpulan data dan model pembelajaran mesin.

Monk berkata: “Orang-orang berkulit gelap telah dikecualikan dari bagaimana berbagai bentuk teknologi ini dikembangkan sejak awal. Anda perlu membangun kumpulan data baru yang memiliki cakupan lebih luas, lebih terwakili dalam hal warna kulit dan itu berarti Anda memerlukan semacam ukuran yang terstandarisasi, konsisten, dan lebih representatif dibandingkan skala sebelumnya.”

PUBLISITAS

Baca juga:

* Teks artikel ini sebagian dihasilkan oleh alat kecerdasan buatan, model bahasa canggih yang membantu dalam persiapan, peninjauan, penerjemahan, dan ringkasan teks. Entri teks dibuat oleh Curto Berita dan tanggapan dari alat AI digunakan untuk meningkatkan konten akhir.

Penting untuk digarisbawahi bahwa alat AI hanyalah alat, dan tanggung jawab akhir atas konten yang dipublikasikan terletak pada Curto Berita. Dengan menggunakan alat-alat ini secara bertanggung jawab dan etis, tujuan kami adalah memperluas kemungkinan komunikasi dan mendemokratisasi akses terhadap informasi berkualitas. 🤖