מחקר שנערך לאחרונה על ידי צ'ק פוינט תוכנה טכנולוגיות, ספקית פתרונות אבטחת סייבר, ניתח את ההשפעה הפוטנציאלית של AI גנרטיבי על הבחירות הדמוקרטיות הקרובות. החוקרים זיהו שני סיכונים עיקריים:

פִּרסוּם

- מניפולציה של בוחרים: ניתן להשתמש בבינה מלאכותית ליצירת טקסטים מותאמים אישית שקשה להבחין בהם מטקסטים שנכתבו על ידי אדם. זה יכול לשמש כדי לתמרן את הבוחרים על ידי הפצת דיסאינפורמציה או תעמולה.

- השמצה של מועמדים: ניתן להשתמש בבינה מלאכותית ליצירת סרטונים ותמונות מזויפות עמוקות, שהן מציאותיות מספיק כדי להיראות אותנטיות. זה יכול לשמש כדי להשמיץ מועמדים או להפיץ חדשות מזויפות.

חוקרים מזהירים כי סיכונים אלו הם אמיתיים ודורשים גישה רב-גונית כדי להפחית. הם מדגישים את הצורך:

- למד את הבוחרים לגבי הפוטנציאל למניפולציה של AI.

- לפתח כלים לאיתור ולהילחם במידע מוטעה ובתעמולה.

- להסדיר את השימוש ב-AI בקמפיינים פוליטיים.

בינה מלאכותית יכולה להפריע לתהליך הדמוקרטי, אבל בני אדם חייבים ללמוד להבחין במידע

חינוך הבוחר חיוני כדי שיוכלו להבחין בין מידע אמיתי לשקרי. הבוחרים חייבים להיות מסוגלים לזהות סימנים של תוכן שעבר מניפולציות, כגון שגיאות שפה או חוסר עקביות עובדתית.

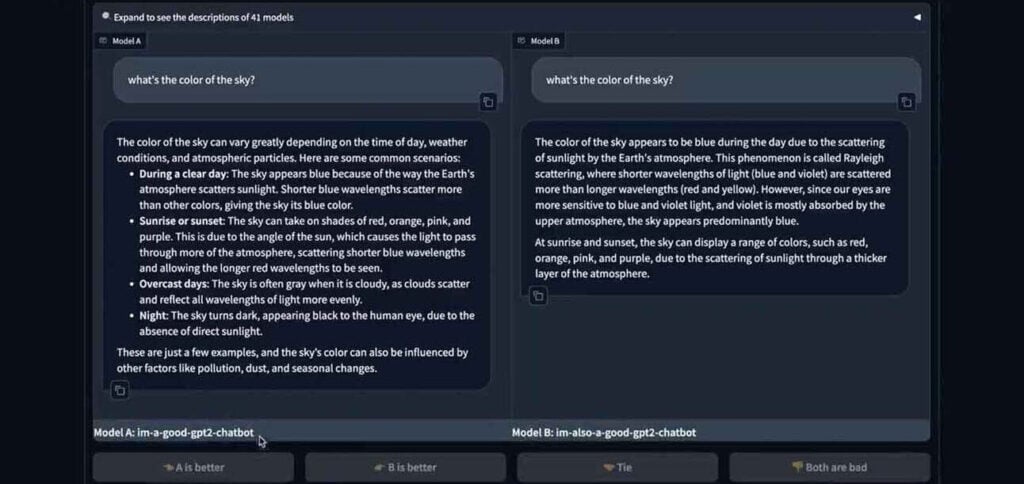

המחקר גם מצביע על כך שחשוב לפתח כלים לאיתור ולהילחם במידע מוטעה ותעמולה. כלים אלה יכולים להשתמש בבינה מלאכותית כדי לזהות תוכן שעבר מניפולציות ולהתריע בפני מצביעים.

פִּרסוּם

לבסוף, על פי ההנחיות של צ'ק פוינט, יש צורך לשקול הסדרת השימוש ב-AI בקמפיינים פוליטיים. זה יכול לכלול כללים להגבלת השימוש בזיופים עמוקים או לדרוש זיהוי של תוכן שנוצר בינה מלאכותית.

כדאי לזכור שלאחרונה, בבחירות בארה"ב ובקמפיינים בקנדה, תמונות שנוצרו על ידי AI עבור קמפיינים כבר עוררו אזהרה לגבי שימוש לרעה בטכנולוגיה לדיסאינפורמציה.

ראה גם:

* הטקסט של מאמר זה נוצר בחלקו על ידי כלים של בינה מלאכותית, מודלים שפה מתקדמים המסייעים בהכנה, סקירה, תרגום וסיכום של טקסטים. רשומות טקסט נוצרו על ידי Curto נעשה שימוש בחדשות ותגובות מכלי AI כדי לשפר את התוכן הסופי.

חשוב להדגיש שכלי בינה מלאכותית הם רק כלים, והאחריות הסופית על התוכן המפורסם היא של Curto חֲדָשׁוֹת. על ידי שימוש בכלים אלה בצורה אחראית ואתית, המטרה שלנו היא להרחיב את אפשרויות התקשורת ולהפוך את הגישה למידע איכותי לדמוקרטי. 🤖

פִּרסוּם