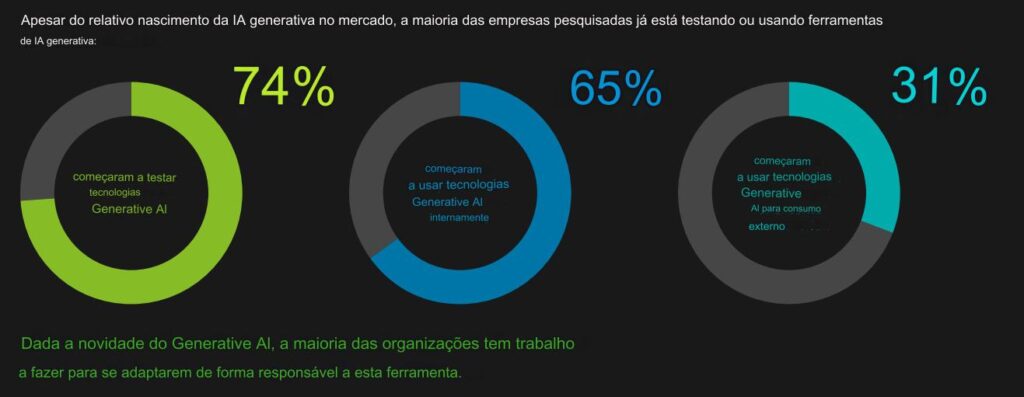

と題された研究 「テクノロジーに対する倫理と信頼の現状」は、回答者の 74% が自社が生成 AI のテストを開始していることを確認しており、65% がすでに組織内で生成 AI を使用していることを示しています。しかし、56% はこのテクノロジーに関する自社の倫理基準が不明であるか、認識していません。

宣伝

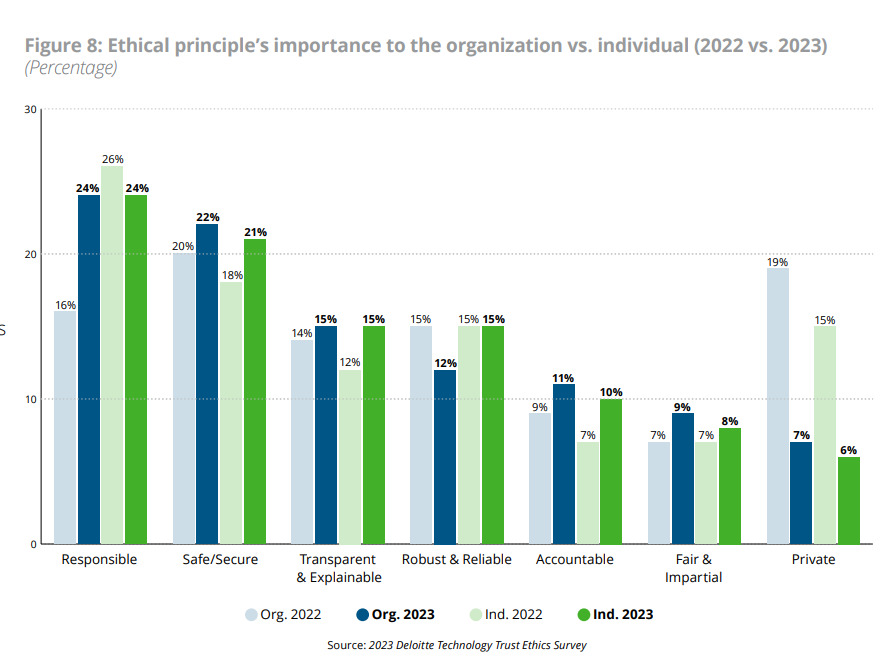

データ プライバシーは生成 AI に関連する倫理的懸念のトップであり、回答者の 22% がそれを最大の懸念事項として挙げています。しかし、データプライバシーの重要性は、昨年の調査では 19% でしたが、今年はわずか 7% に低下しました。

懸念にもかかわらず、回答者の 39% は、生成 AI を含むコグニティブ テクノロジーが、すべての新興テクノロジーの中で社会的利益に最も大きな可能性を秘めていると信じています。しかし、57% はコグニティブ テクノロジーが深刻な倫理的リスクを引き起こす可能性が高いと認識しており、これは 41 年の 2022% の大幅な増加を反映しています。

この調査では、組織が自動化に適応し、従業員の維持とスキルアップを図り、離職の恐れと闘っていることも明らかになりました。興味深いことに、回答者のわずか 7% が、AI の生成的利用に関連する最大の倫理的懸念として離職を挙げています。

宣伝

さらに、調査によると、倫理テクノロジー基準の設定に対する政府の関与に対する期待の変化が示されています。自社が営利団体と協力していると回答したのは回答者のわずか27%だったが、71%が倫理基準の設定において政府がより重要な役割を果たすべきだと考えており、前年調査の61%から増加した。

以下も参照してください。

* この記事のテキストの一部は、テキストの準備、レビュー、翻訳、要約を支援する最先端の言語モデルである人工知能ツールによって生成されました。テキストエントリは、 Curto AI ツールからのニュースと応答は、最終的なコンテンツを改善するために使用されました。

AI ツールは単なるツールであり、公開されたコンテンツに対する最終的な責任は AI ツールにあることを強調することが重要です。 Curto ニュース。これらのツールを責任を持って倫理的に使用することで、コミュニケーションの可能性を拡大し、質の高い情報へのアクセスを民主化することが私たちの目的です。 🤖