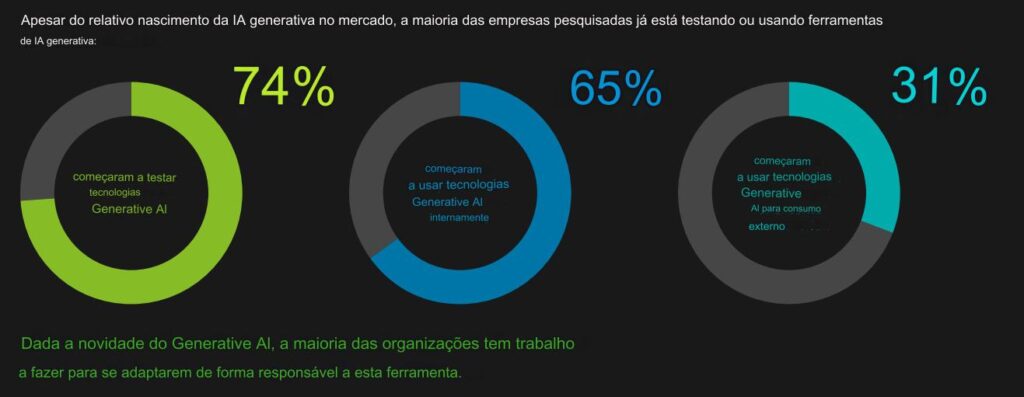

연구 제목 “윤리현황과 기술신뢰”, 응답자의 74%는 자신의 회사가 생성 AI 테스트를 시작했으며 65%는 이미 조직에서 이를 사용하고 있다고 확인했습니다. 그러나 56%는 이 기술과 관련된 회사의 윤리적 기준에 대해 확신이 없거나 인식하지 못하고 있습니다.

널리 알려짐

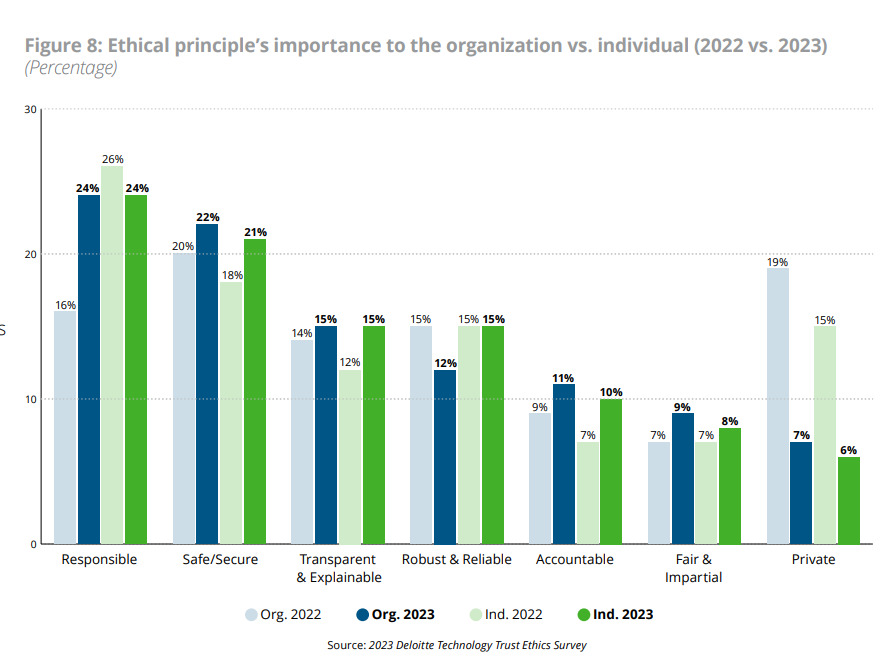

데이터 개인정보 보호는 생성 AI와 관련된 가장 큰 윤리적 우려 사항으로, 응답자의 22%가 이를 가장 큰 우려 사항으로 꼽았습니다. 그러나 데이터 프라이버시에 대한 중요성은 작년 조사의 19%에서 올해는 7%로 떨어졌습니다.

우려에도 불구하고 응답자의 39%는 생성 AI를 포함한 인지 기술이 모든 신흥 기술 중에서 사회적 이익을 위한 가장 큰 잠재력을 가지고 있다고 믿고 있습니다. 그러나 57%는 인지 기술이 심각한 윤리적 위험에 대한 잠재력이 더 크다고 인식하며, 이는 41년에 2022%의 상당한 증가를 반영합니다.

이 연구는 또한 조직이 자동화에 적응하고, 직원을 유지하고 기술을 향상시키며, 일자리 대체에 대한 두려움에 맞서 싸우고 있음을 보여줍니다. 흥미롭게도 응답자의 7%만이 일자리 대체를 AI의 생성적 사용과 관련된 가장 큰 윤리적 문제로 꼽았습니다.

널리 알려짐

또한, 연구에 따르면 윤리적 기술 표준 설정에 정부가 개입하는 것에 대한 기대가 바뀌고 있는 것으로 나타났습니다. 응답자의 27%만이 자신의 회사가 영리 단체와 협력한다고 보고한 반면, 71%는 정부가 윤리 표준 설정에 있어 더 중요한 역할을 해야 한다고 생각합니다. 이는 전년도 조사의 61%보다 증가한 수치입니다.

참조 :

* 이 기사의 텍스트는 텍스트 준비, 검토, 번역 및 요약을 지원하는 최첨단 언어 모델인 인공 지능 도구를 통해 부분적으로 생성되었습니다. 텍스트 항목은 다음에 의해 생성되었습니다. Curto AI 도구의 뉴스와 답변을 활용해 최종 콘텐츠를 개선했습니다.

AI 도구는 도구일 뿐이며 게시된 콘텐츠에 대한 최종 책임은 AI에게 있다는 점을 강조하는 것이 중요합니다. Curto 소식. 이러한 도구를 책임감 있고 윤리적으로 사용함으로써 우리의 목표는 커뮤니케이션 가능성을 확대하고 고품질 정보에 대한 접근을 민주화하는 것입니다. 🤖