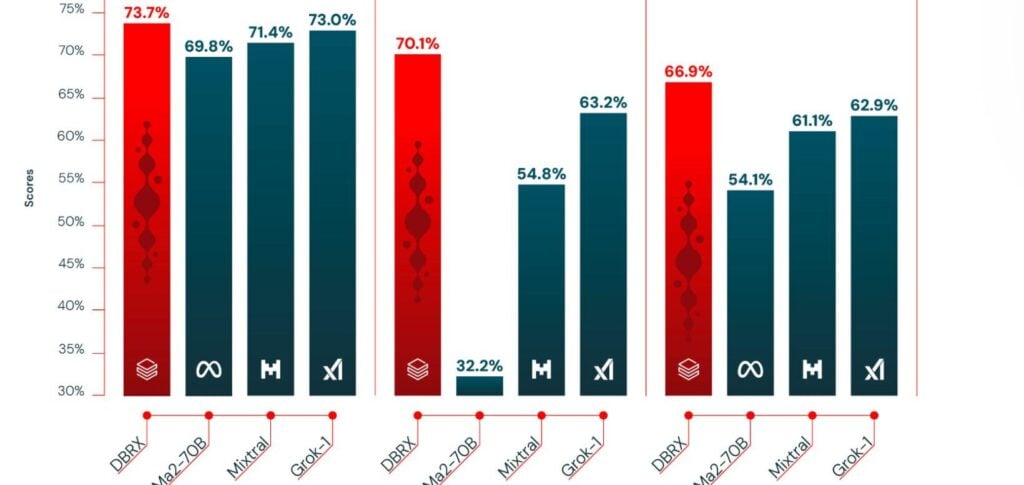

O DBRX utkonkurrerer ledende åpen kildekode-modeller som Mixtral MoE, Llama-2 70B og Grok-1, i språkforståelse, programmering og matematikk.

REKLAME

I tillegg er konklusjonen opptil 2 ganger raskere enn LLaMA2-70B og er omtrent 40 % av størrelsen på Grok-1 totalt og aktive parameterteller.

Modellen demonstrerer også overlegenhet i forhold til GPT-3.5 i langkontekstoppgaver og RAG-benchmarks.

Overraskende nok tok det bare 10 millioner dollar og to måneder å trene DBRX fra bunnen av, og fremhever effektiviteten og effektiviteten i utviklingen av språkmodeller.

REKLAME

Databricks' etablering av en GPT 3.5-nivåmodell med bare $10 millioner og to måneder setter en ny standard for industrien. Selv om det er imponerende å toppe poengtavlen for åpen kildekode, er den nært forestående ankomsten av selskapets etterlengtede Llama 3 Meta antyder at modellen neppe vil forbli på toppen lenge.

Les også:

* Teksten til denne artikkelen ble delvis generert av verktøy for kunstig intelligens, toppmoderne språkmodeller som hjelper til med utarbeidelse, gjennomgang, oversettelse og oppsummering av tekster. Tekstoppføringer ble opprettet av Curto Nyheter og svar fra AI-verktøy ble brukt til å forbedre det endelige innholdet.

Det er viktig å fremheve at AI-verktøy bare er verktøy, og det endelige ansvaret for det publiserte innholdet ligger hos Curto Nyheter. Ved å bruke disse verktøyene ansvarlig og etisk, er vårt mål å utvide kommunikasjonsmuligheter og demokratisere tilgang til kvalitetsinformasjon. 🤖

Leter du etter et kunstig intelligensverktøy for å gjøre livet ditt enklere? I denne veiledningen, blar du gjennom en katalog over AI-drevne roboter og lærer om funksjonene deres. Sjekk ut evalueringen som vårt team av journalister ga dem!

REKLAME