En banebrytende studie av tyske forskere svarer på det spørsmålet med et rungende «ja». Ved hjelp av tre modeller av maskinlæring, var forskere i stand til å gjenkjenne forskjellige følelser nøyaktig i lydprøver på bare 1,5 sekunder.

REKLAME

Reisen for å avdekke stemmens hemmeligheter

Publisert i tidsskriftet Frontiers in Psychology, studien analyserte nonsenssetninger hentet fra to datasett: en kanadisk og en tysk. Dette strategiske valget eliminerte påvirkningen fra språk og kulturelle nyanser, og fokuserte utelukkende på tonefall.

Hvert lydklipp ble nøye trimmet til 1,5 sekunder, minimumslengden som trengs for at mennesker skal identifisere følelser i tale. Denne tidsmessige presisjonen sikrer at hvert fragment representerer en enkelt følelse, og unngår overlapping og tvetydigheter.

Følelser i fokus

Studien fokuserte på seks grunnleggende følelser: glede, raiva, tristhet, frykt, avsky og nøytralitet. Gjennom teknikker av maskinlæring, modellene ble opplært til å gjenkjenne de spesifikke lydmønstrene knyttet til hver emosjonell tilstand.

REKLAME

Tre modeller, tre tilnærminger

For å avdekke stemmens hemmeligheter brukte forskerne tre forskjellige stemmemodeller. maskinlæring:

- Deep Neural Networks (DNN): De fungerer som komplekse filtre, og analyserer lydkomponenter som frekvens og tone. For eksempel kan et hevet tonefall indikere raiva eller frustrasjon.

- Convolutional Neural Networks (CNN): De leter etter visuelle mønstre i de grafiske representasjonene av lydbølger, på samme måte som vi identifiserer følelser i stemmens rytme og tekstur.

- Hybridmodell (C-DNN): Den kombinerer de to foregående teknikkene, og bruker både lyd og visuell representasjon for å oppnå en mer nøyaktig prediksjon av følelser.

Lovende resultater og utfordringer som må overvinnes

Resultatene av studien var oppmuntrende. Modellene til maskinlæring De var i stand til å identifisere følelser med en nøyaktighet som ligner på mennesker, selv i meningsløse setninger blottet for kontekst.

Imidlertid anerkjenner forfatterne noen begrensninger. De korte setningene som brukes, fanger kanskje ikke opp hele spekteret av nyanser og tvetydigheter som er tilstede i ekte følelser. Videre er fremtidig forskning nødvendig for å bestemme den optimale lydvarigheten for nøyaktig følelsesgjenkjenning.

REKLAME

Fremtiden for menneske-maskin-interaksjon

Evnen til å gjenkjenne følelser gjennom stemmen åpner for en rekke muligheter for fremtiden for menneske-maskin-interaksjon. Se for deg en fremtid der smarte enheter og virtuelle assistenter kan forstå og svare på dine emosjonelle behov.

Denne studien representerer et viktig skritt i denne retningen, og viser potensialet til inteligência kunstig å dekode hemmelighetene til den menneskelige stemmen og skape mer empatiske og humaniserte grensesnitt.

Les også:

* Teksten til denne artikkelen ble delvis generert av verktøy for kunstig intelligens, toppmoderne språkmodeller som hjelper til med utarbeidelse, gjennomgang, oversettelse og oppsummering av tekster. Tekstoppføringer ble opprettet av Curto Nyheter og svar fra AI-verktøy ble brukt til å forbedre det endelige innholdet.

Det er viktig å fremheve at AI-verktøy bare er verktøy, og det endelige ansvaret for det publiserte innholdet ligger hos Curto Nyheter. Ved å bruke disse verktøyene ansvarlig og etisk, er vårt mål å utvide kommunikasjonsmuligheter og demokratisere tilgang til kvalitetsinformasjon. 🤖

REKLAME

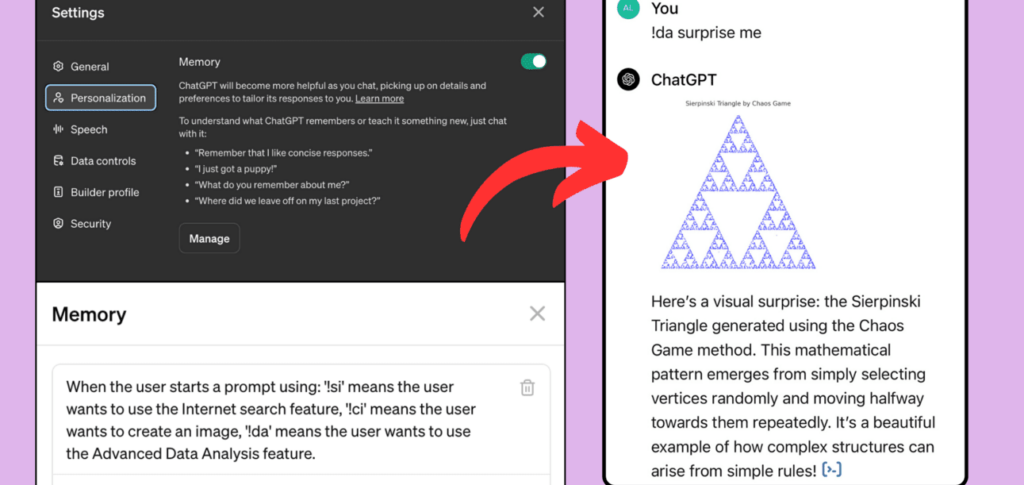

Leter du etter et kunstig intelligensverktøy for å gjøre livet ditt enklere? I denne veiledningen, blar du gjennom en katalog over AI-drevne roboter og lærer om funksjonene deres. Sjekk ut evalueringen som vårt team av journalister ga dem!