Przełomowe badanie przeprowadzone przez niemieckich naukowców odpowiada na to pytanie zdecydowanym „tak”. Korzystając z trzech modeli uczenie maszynowenaukowcom udało się dokładnie rozpoznać różne emocje w próbkach audio trwających zaledwie 1,5 sekundy.

PUBLICIDADA

Podróż w celu odkrycia tajemnic głosu

Opublikowano w czasopiśmie Frontiers in Psychology, w badaniu przeanalizowano nonsensowne zdania pobrane z dwóch zbiorów danych: jednego kanadyjskiego i jednego niemieckiego. Ten strategiczny wybór wyeliminował wpływ języka i niuansów kulturowych, koncentrując się wyłącznie na tonie głosu.

Każdy klip audio został starannie przycięty do 1,5 sekundy, czyli minimalnej długości potrzebnej ludziom do zidentyfikowania emocji w mowie. Ta czasowa precyzja gwarantuje, że każdy fragment reprezentuje pojedynczą emocję, co pozwala uniknąć nakładania się i niejasności.

Emocje w centrum uwagi

W badaniu skupiono się na sześciu podstawowych emocjach: radości, raiva, smutek, strach, wstręt i neutralność. Poprzez techniki uczenie maszynowe, modele zostały przeszkolone w zakresie rozpoznawania specyficznych wzorców dźwiękowych związanych z każdym stanem emocjonalnym.

PUBLICIDADA

Trzy modele, trzy podejścia

Aby odkryć tajemnice głosu, badacze wykorzystali trzy różne modele głosu. uczenie maszynowe:

- Głębokie sieci neuronowe (DNN): Działają jak złożone filtry, analizując komponenty dźwięku, takie jak częstotliwość i ton. Na przykład podniesiony ton głosu może wskazywać raiva lub frustracja.

- Konwolucyjne sieci neuronowe (CNN): Szukają wzorców wizualnych w graficznych przedstawieniach fal dźwiękowych, podobnie jak identyfikujemy emocje w rytmie i fakturze głosu.

- Model hybrydowy (C-DNN): Łączy w sobie dwie poprzednie techniki, wykorzystując zarówno dźwięk, jak i jego reprezentację wizualną, aby uzyskać dokładniejsze przewidywanie emocji.

Obiecujące wyniki i wyzwania do pokonania

Wyniki badania były zachęcające. Modele uczenie maszynowe Potrafili identyfikować emocje z dokładnością porównywalną do ludzkiej, nawet w bezsensownych zdaniach pozbawionych kontekstu.

Autorzy dostrzegają jednak pewne ograniczenia. Zastosowane krótkie zdania mogą nie oddać pełnego zakresu niuansów i niejasności występujących w prawdziwych emocjach. Ponadto potrzebne są przyszłe badania w celu określenia optymalnego czasu trwania dźwięku w celu dokładnego rozpoznawania emocji.

PUBLICIDADA

Przyszłość interakcji człowiek-maszyna

Zdolność rozpoznawania emocji za pomocą głosu otwiera szereg możliwości dla przyszłej interakcji człowiek-maszyna. Wyobraź sobie przyszłość, w której inteligentne urządzenia i wirtualni asystenci będą mogli zrozumieć Twoje potrzeby emocjonalne i odpowiedzieć na nie.

Niniejsze badanie stanowi ważny krok w tym kierunku i pokazuje potencjał inteligência sztuczne rozszyfrować sekrety ludzkiego głosu i stworzyć bardziej empatyczne i humanizowane interfejsy.

Przeczytaj także:

* Tekst tego artykułu został częściowo wygenerowany przez narzędzia sztucznej inteligencji, najnowocześniejsze modele językowe, które pomagają w przygotowaniu, recenzowaniu, tłumaczeniu i podsumowywaniu tekstów. Wpisy tekstowe zostały utworzone przez Curto Do ulepszenia ostatecznej treści wykorzystano wiadomości i odpowiedzi z narzędzi AI.

Należy podkreślić, że narzędzia AI to tylko narzędzia i ostateczna odpowiedzialność za publikowane treści spoczywa na nich Curto Aktualności. Korzystając z tych narzędzi w sposób odpowiedzialny i etyczny, naszym celem jest poszerzenie możliwości komunikacji i demokratyzacja dostępu do wysokiej jakości informacji. 🤖

PUBLICIDADA

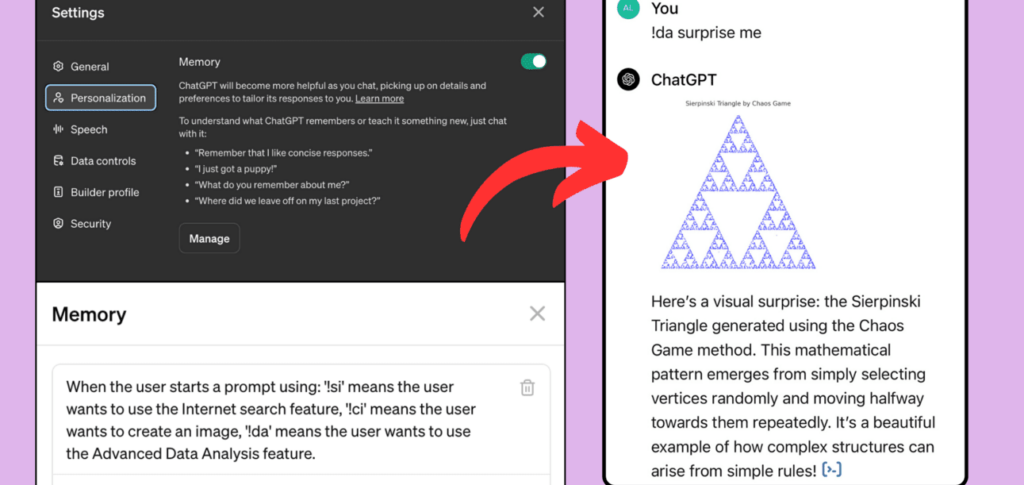

Szukasz narzędzia sztucznej inteligencji, które ułatwi Ci życie? W tym przewodnikuprzeglądasz katalog robotów napędzanych sztuczną inteligencją i poznajesz ich funkcjonalności. Zapoznaj się z oceną, jaką wystawiła im nasza ekipa dziennikarzy!