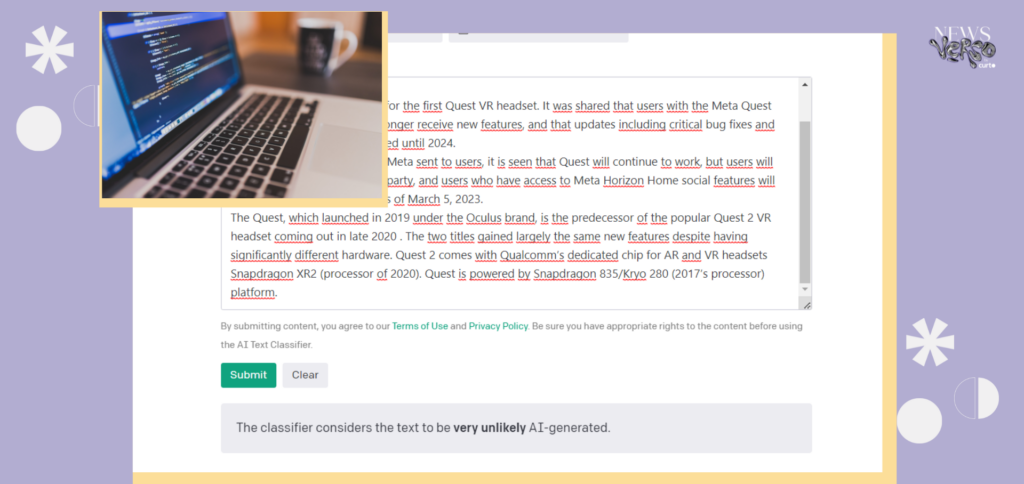

Zatytułowany „Klasyfikator tekstu AI”, narzędzie działa w następujący sposób: pobierasz podejrzany tekst, który mógł zostać stworzony przez sztuczną inteligencję, i wklejasz go we wskazanym miejscu. Następnie witryna sprawdzi i zaklasyfikuje materiał pisemny jako:

PUBLICIDADA

- Jest bardzo mało prawdopodobne, że zostały wygenerowane przez sztuczną inteligencję

- Mało prawdopodobny

- Niejasny

- Możliwe lub prawdopodobne.

Zrozumieć:

Narzędzie jest w fazie testów

Pomimo łatwości konsultacji z tekstem, szef wyrównania OpenAI, Jan Leike, powiedział w rozmowie z portalem Axios w Stanach Zjednoczonych, że mogą występować „fałszywie pozytywne i fałszywie negatywne wyniki”.

Osoba odpowiedzialna za OpenAI Mówi również, że aby zmniejszyć ryzyko awarii platformy, zaleca się, aby wklejane teksty zawierały więcej niż 1000 słów i najlepiej były w języku angielskim.

Obawy dot ChatGPT

Obawy wokół treści generowanych przez sztuczną inteligencję pojawiły się po tym, jak nauczyciele i podmioty na całym świecie ujawnili, że ChatGPT był używany do czynności, które powinny być wykonywane przez ludzi. Na przykład szkoły w Nowym Jorku zakazały nawet stosowania sztucznej inteligencji.

PUBLICIDADA

A OpenAI mówi też, że pracuje nad innymi narzędziami do identyfikacji materiałów wytwarzanych przez sztuczną inteligencję. Alternatywą jest dołączenie znaków wodnych i ulepszenie witryny sprawdzającej tekst.