@curtonews คนรักขอความช่วยเหลือ? เลขที่! มันเป็นกลโกงปัญญาประดิษฐ์... ระวัง 🚨 #newsversobyCurto ♬ เสียงต้นฉบับ – Curto ข่าว

ปัญญาประดิษฐ์ได้กลายเป็นเครื่องมือสำหรับผู้หลอกลวง

มันก็เป็นเช่นนั้น เรารู้อยู่แล้วว่า IA มันถูกใช้สำหรับหลายอย่าง รวมถึง – น่าเสียดาย – เพื่อช่วยเหลือและเพิ่มการหลอกลวงที่เป็นที่รู้จัก

การเผยแพร่

O การหลอกลวง Whatsapp – เมื่ออาชญากรแกล้งทำเป็นคนรักตกอยู่ในอันตรายและขอ/ทวงถามเงิน ไม่ใช่เรื่องง่าย แต่ผู้คนหลายพันคนยังคงตกเป็นเหยื่อทุกวัน 😖

ตอนนี้เคล็ดลับนี้ได้รับเคล็ดลับอื่น: เนื่องจากความง่ายในการใช้โปรแกรม AI อาชญากรจึงสามารถคัดลอกคำพูดของใครก็ได้จากตัวอย่างเพียงไม่กี่วินาที โดยทั่วไปแล้ว เทคโนโลยีที่ใช้จะเป็น Deepfake ซึ่งสามารถจัดการเสียงและจำลองเสียงบางอย่าง เช่น เสียงต่ำและน้ำเสียง.

ส่งผลให้แต่ละบุคคลเกิดความยุ่งยากขึ้น questionไม่ว่าคุณกำลังพูดคุยกับคนที่คุณรู้จักจริงๆ หรือไม่ก็ตาม

การเผยแพร่

การหลอกลวงทำให้ขาดทุนไปแล้วกว่า 11 ล้านเหรียญสหรัฐ

ตามรายงานจาก วอชิงตันโพสต์ (*🚥) ในสหรัฐอเมริกา การหลอกลวงประเภทนี้ได้กลายเป็นที่นิยมมากที่สุดเป็นอันดับสองในหมู่นักหลอกลวง โดยมีรายงานมากกว่า 36 รายงานในปี 2022 เพียงปีเดียว ตามข้อมูลของ คณะกรรมาธิการการค้าของรัฐบาลกลาง (เอฟทีซี). เป็นผลให้มีการขโมยเงินมากกว่า 11 ล้านเหรียญสหรัฐ 💸

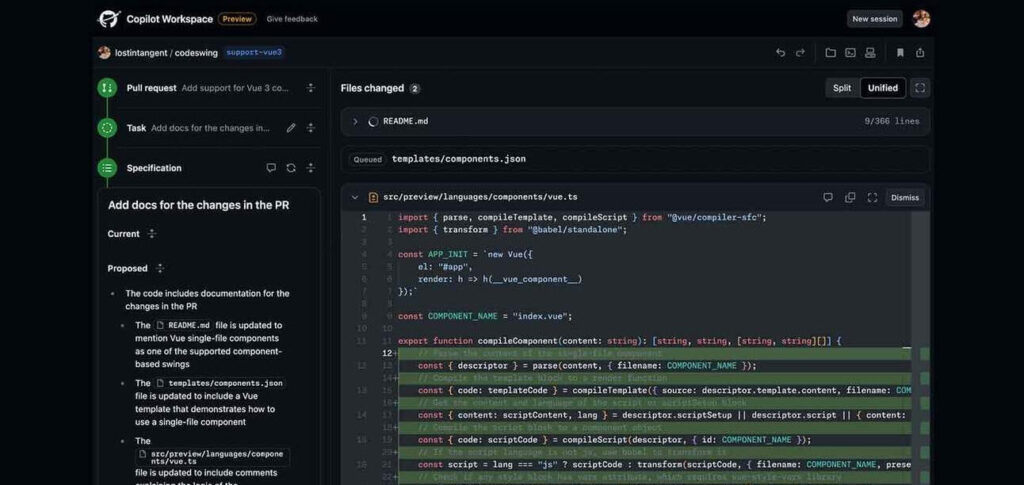

เครื่องมือใหม่จาก Microsoft

และสถานการณ์ promeทำให้คุณแย่ลงเห็นไหม? ด้วยการเพิ่มขึ้นของเครื่องมือ AI เหล่านี้ การหลอกลวงควรจะเกิดขึ้นบ่อยและซับซ้อนมากขึ้น

A Microsoftตัวอย่างเช่น พัฒนา AI ที่สามารถจำลองเสียงของมนุษย์จากตัวอย่างที่มีความยาวอย่างน้อยสามวินาที 😱

การเผยแพร่

ฝึกฝนด้วยเสียงภาษาอังกฤษมากกว่า 60 ชั่วโมง ไอเอ วัล-อี สามารถสร้างสุนทรพจน์จากข้อความ จำลองอารมณ์ น้ำเสียง และการแสดงออกต่างๆ ได้ (เทคมันโด)

มันไม่ง่ายเลย แต่ต้องใส่ใจเป็นพิเศษ โอเคไหม? 🙃

อ่านเพิ่มเติม:

(🇧🇧): เนื้อหาเป็นภาษาอังกฤษ

(*): เนื้อหาเป็นภาษาอื่นแปลโดย Google นักแปล

(🚥): อาจต้องลงทะเบียนและ/หรือสมัครสมาชิก