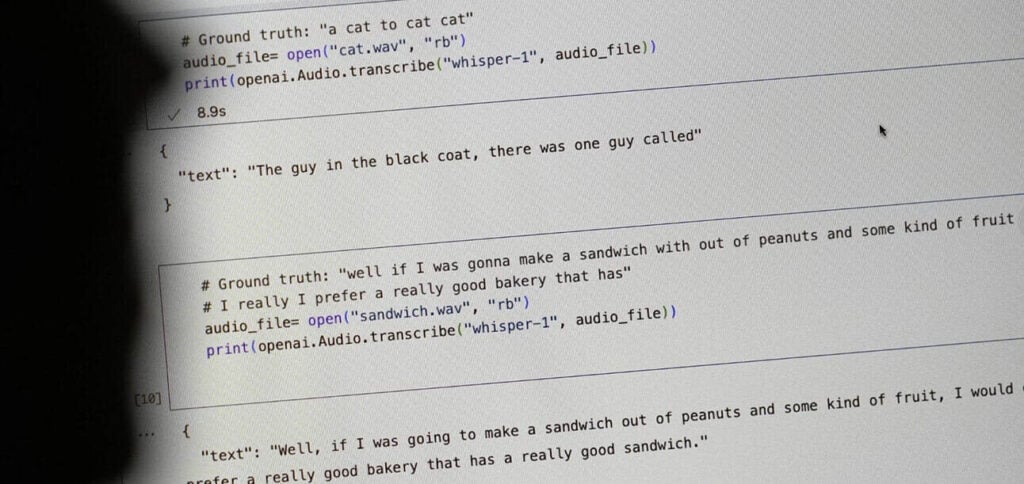

各研究人员 提出了担忧 发现之后 耳语转录工具 OpenAI 尽管在医疗保健环境中广泛使用,但他经常出现幻觉,并发明了从未出现在录音中的文本。

宣传

细节

密歇根州的一位研究人员发现,80% 的检查笔录中有捏造的文本,而另一位研究人员则报告说,“几乎所有”Whisper 结果中都存在幻觉。幻觉varia范围从不存在的医疗到种族评论和暴力内容。

超过 30.000 名医疗专业人员使用基于 Whisper 的工具,尽管来自 OpenAI 针对高风险应用程序, 据美联社报道。根据 Hugging Face 的数据,Whisper 也是最受欢迎的开源语音模型,仅上个月的下载量就超过 4,2 万次。

为什么这有关系?

幻觉现在是情报系统中一个不幸的事实。 人工智能 (IA) – 在它们可靠地解决到 100% 之前, 部署 在高风险环境中,这可能会导致灾难。然而,商业压力似乎超过了足够的保障措施,所有行业都争先恐后地乘着人工智能浪潮。

宣传

阅读: