A startup chinesa de inteligência artificial (IA) DeepSeek acaba de lançar o DeepSeek-V3, um novo e poderoso modelo de linguagem que estabelece novos padrões no mundo da IA de código aberto, com desempenho rivalizando gigantes da indústria a uma fração do custo.

PUBLICIDADE

Detalhes do lançamento

- O V3 usa uma arquitetura Mixture-of-Experts e mantém velocidade e custo-efetividade apesar de seu tamanho massivo de 671 bilhões de parâmetros.

- O treinamento foi concluído em apenas dois meses a um custo estimado de US$ 5,57 milhões, drasticamente menor do que os relatados mais de US$ 500 milhões gastos em modelos como LLaMA 3.1.

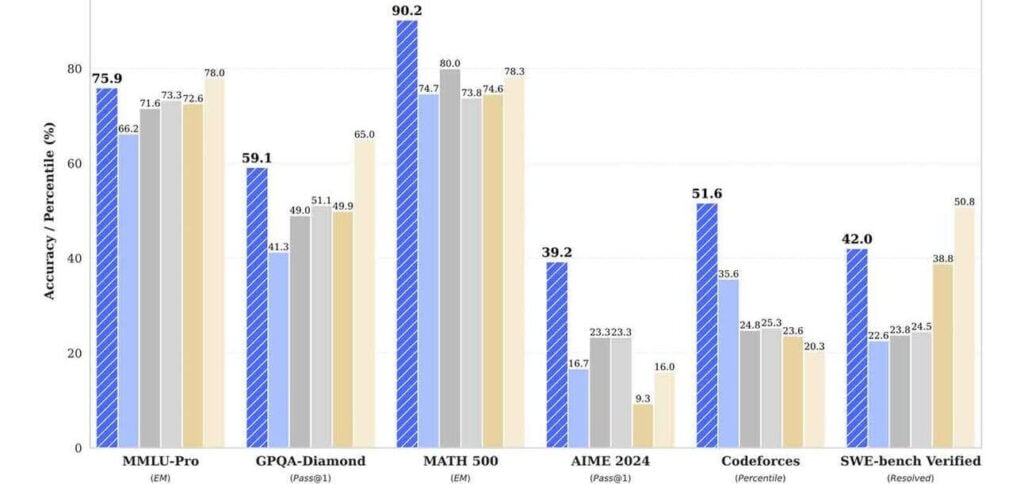

- O modelo mostra força excepcional em tarefas de matemática e língua chinesa, enquanto iguala ou excede modelos fechados na maioria dos benchmarks.

- O V3 foi criticado por se identificar como ChatGPT em conversas, o que pode ser devido ao conteúdo gerado por GPT significativo usado em seu conjunto de dados de treinamento.

Por que isso importa

A lacuna entre modelos de IA abertos e fechados nunca foi tão pequena. Os modelos chineses continuam a provar que as restrições de chips dos EUA estão falhando em retardar o progresso, e os benchmarks do V3 mostram que modelos de alto desempenho de código aberto são alcançáveis sem os recursos massivos de outros gigantes da tecnologia.

Leia também: