A maioria dos detectores de deepfake é baseada em uma estratégia de aprendizado que depende muito do conjunto de dados usado para seu treinamento. Em seguida, eles usam IA para detectar sinais que podem não ser claros ao olho humano.

PUBLICIDADE

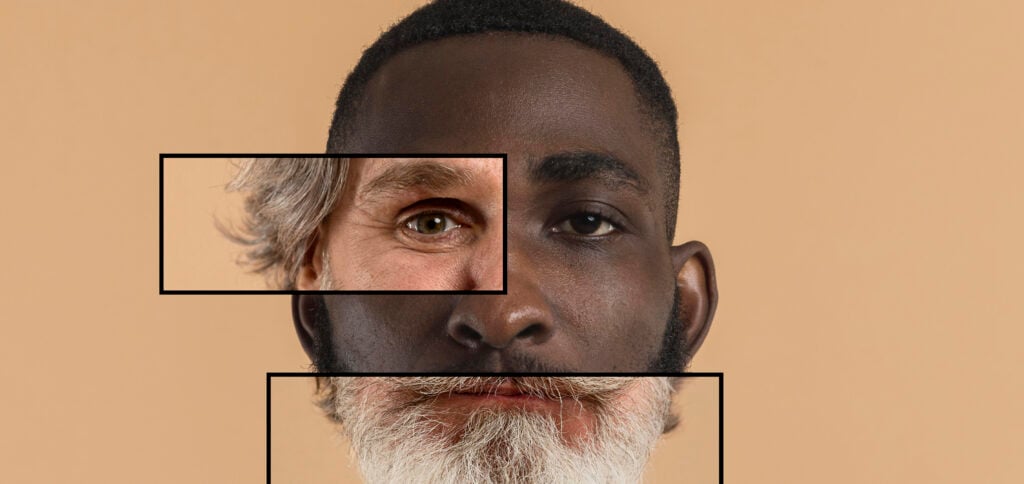

Isso pode incluir o monitoramento do fluxo sanguíneo e da frequência cardíaca. No entanto, esses métodos de detecção nem sempre funcionam em pessoas com tons de pele mais escuros e, se os conjuntos de treinamento não contiverem todas as etnias, sotaques, gêneros, idades e tons de pele, eles estão sujeitos a vieses, alertaram os especialistas.

Viés sendo construído

Nos últimos dois anos, preocupações foram levantadas por especialistas em IA e detecção de deepfake, que dizem que o viés está sendo construído nesses sistemas.

Rijul Gupta, especialista em mídia sintética e cofundador e CEO da DeepMedia, que usa IA e aprendizado de máquina para avaliar pistas visuais e de áudio para sinais de manipulação sintética, disse: “Os conjuntos de dados são sempre fortemente distorcidos para homens brancos de meia-idade, e isso tipo de tecnologia sempre afeta negativamente as comunidades marginalizadas”.

PUBLICIDADE

Escala de Tom de Pele Monk

Ellis Monk, professor de sociologia na Universidade de Harvard e pesquisador visitante do Google, desenvolveu a Escala de Tom de Pele Monk.

É uma escala mais inclusiva do que o padrão da indústria de tecnologia e fornecerá um espectro mais amplo de tons de pele que pode ser usado para conjuntos de dados e modelos de aprendizado de máquina.

Monk disse: “As pessoas de pele mais escura foram excluídas de como essas diferentes formas de tecnologia foram desenvolvidas desde o início. É preciso construir novos conjuntos de dados que tenham mais cobertura, mais representatividade em termos de tom de pele e isso significa que você precisa de algum tipo de medida que seja padronizada, consistente e mais representativa do que as escalas anteriores”.

PUBLICIDADE

Leia também: