Pesquisadores alemães e estadunidenses desenvolveram uma abordagem inovadora, denominada Drag Your GAN, que permite aos usuários ter controle flexível e preciso sobre a pose, forma, expressão e layout dos objetos em imagens paralisadas. Apesar de ainda estar no papel, a ferramenta pode mudar a forma como as pessoas editam suas fotografias.

PUBLICIDADE

Até então, os métodos existentes para “animar” imagens necessitavam de dados de treinamento anotados manualmente ou em modelos 3D pré-existentes. Essas abordagens mostraram limitações em termos de flexibilidade e precisão.

Com DragGAN a pessoa poderá fazer alguém sorrir numa foto apenas arrastando o mouse

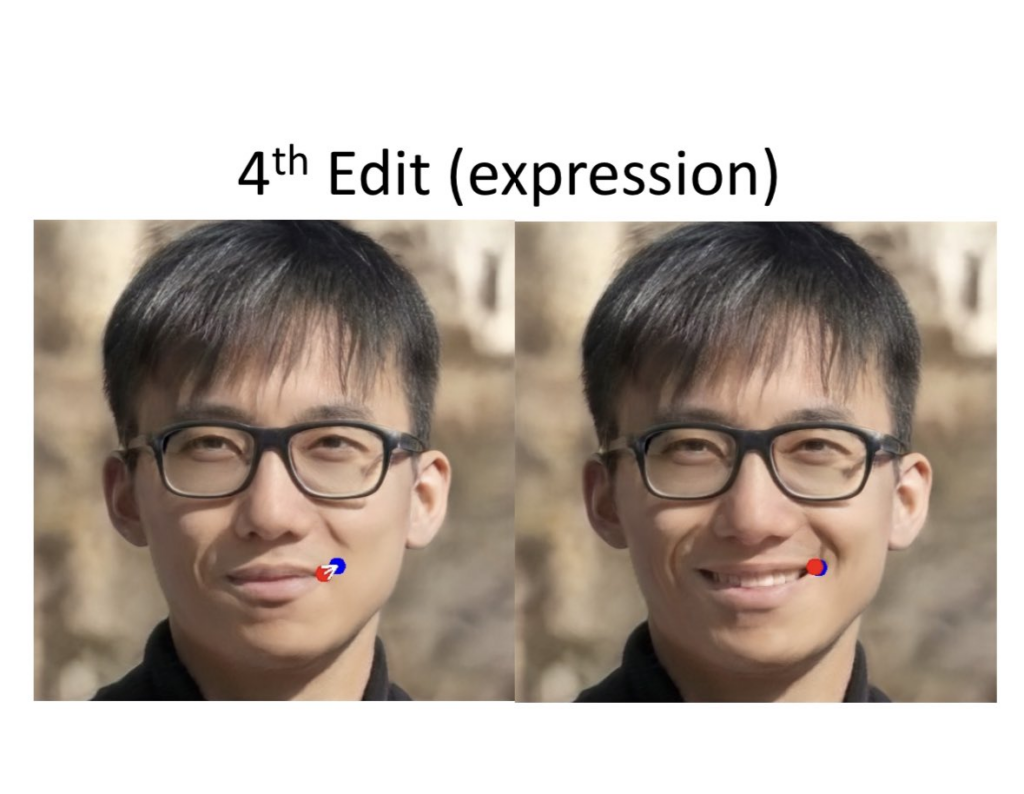

O DragGAN utiliza uma técnica menos explorada, permitindo que os usuários “arrastem” pontos específicos de uma imagem para alcançar resultados desejados de maneira interativa. Só com o dedo ou mouse você consegue fazer alguém sorrir numa foto.

Isso significa que podemos criar imagens de animais, carros, pessoas e paisagens com detalhes personalizados, de uma maneira realista.

PUBLICIDADE

Com o DragGAN, qualquer pessoa pode deformar uma imagem e ter controle preciso sobre a pose, forma, expressão e layout de diversos objetos. Essa flexibilidade permite uma ampla variedade de imagens geradas pela GAN, produzindo resultados realistas mesmo para desafios complexos, como objetos ocultos ou formas deformadas que seguem a rigidez do objeto.

Pode parecer assustador. Mas se usada de maneira ética, essa descoberta promete impulsionar o desenvolvimento de novas aplicações em áreas como design, criação de conteúdo digital e até mesmo em jogos e filmes. Você não vai precisar se submeter a processos complexos no Photoshop, por exemplo, para deixar uma imagem do jeito que quer.

Com esse avanço, a capacidade de controlar e manipular imagens geradas por inteligência artificial ganha uma nova dimensão, abrindo possibilidades fascinantes para a criação de conteúdos visualmente impressionantes e personalizados.

PUBLICIDADE

A ferramenta ainda não está disponível para todo mundo. Apenas desenvolvedores estão testando a plataforma. No entanto, o projeto foi registrado em uma plataforma de compartilhamento de pesquisa com curadoria aberta da Cornell University.

Testadores também publicaram no Twitter prévias de como vai funcionar a ferramenta quando liberada para geral.

Veja também: